立即发布

研究人员开发了一种名为MonoCon的新技术,该技术可以提高人工智能(AI)程序识别三维物体的能力,以及这些物体如何通过二维图像在空间中相互关联。例如,这项工作将帮助用于自动驾驶汽车的人工智能使用车载摄像头接收到的2D图像与其他车辆进行导航。

“我们生活在一个3D世界,但当你拍照时,它会以2D图像记录下这个世界,”北卡罗莱纳州立大学电子与计算机工程助理教授、该研究论文的通讯作者吴天福说。

“人工智能程序接收摄像机的视觉输入。因此,如果我们想让AI与世界互动,我们需要确保它能够解释2D图像能够告诉它关于3D空间的信息。在这项研究中,我们关注的是这一挑战的一部分:如何让人工智能准确识别2D图像中的3D物体,比如人或汽车,并将这些物体放置在空间中。”

虽然这项工作对自动驾驶汽车可能很重要,但它也可以应用于制造业和机器人技术。

在自动驾驶汽车的背景下,大多数现有的系统都依赖激光雷达——它使用激光测量距离——来导航3D空间。然而,激光雷达技术是昂贵的。而且由于激光雷达价格昂贵,自动系统不包含太多冗余。例如,在一辆大规模生产的无人驾驶汽车上安装几十个激光雷达传感器将过于昂贵。

“但如果自动驾驶汽车可以使用视觉输入在空间中导航,你就可以制造冗余,”吴说。“由于相机比激光雷达便宜得多,在经济上,增加额外的相机将是可行的——在系统中建立冗余,使其更安全,更坚固。”

这是一个实际应用。然而,我们也对这项工作的根本进展感到兴奋:从2D对象获得3D数据是可能的。”

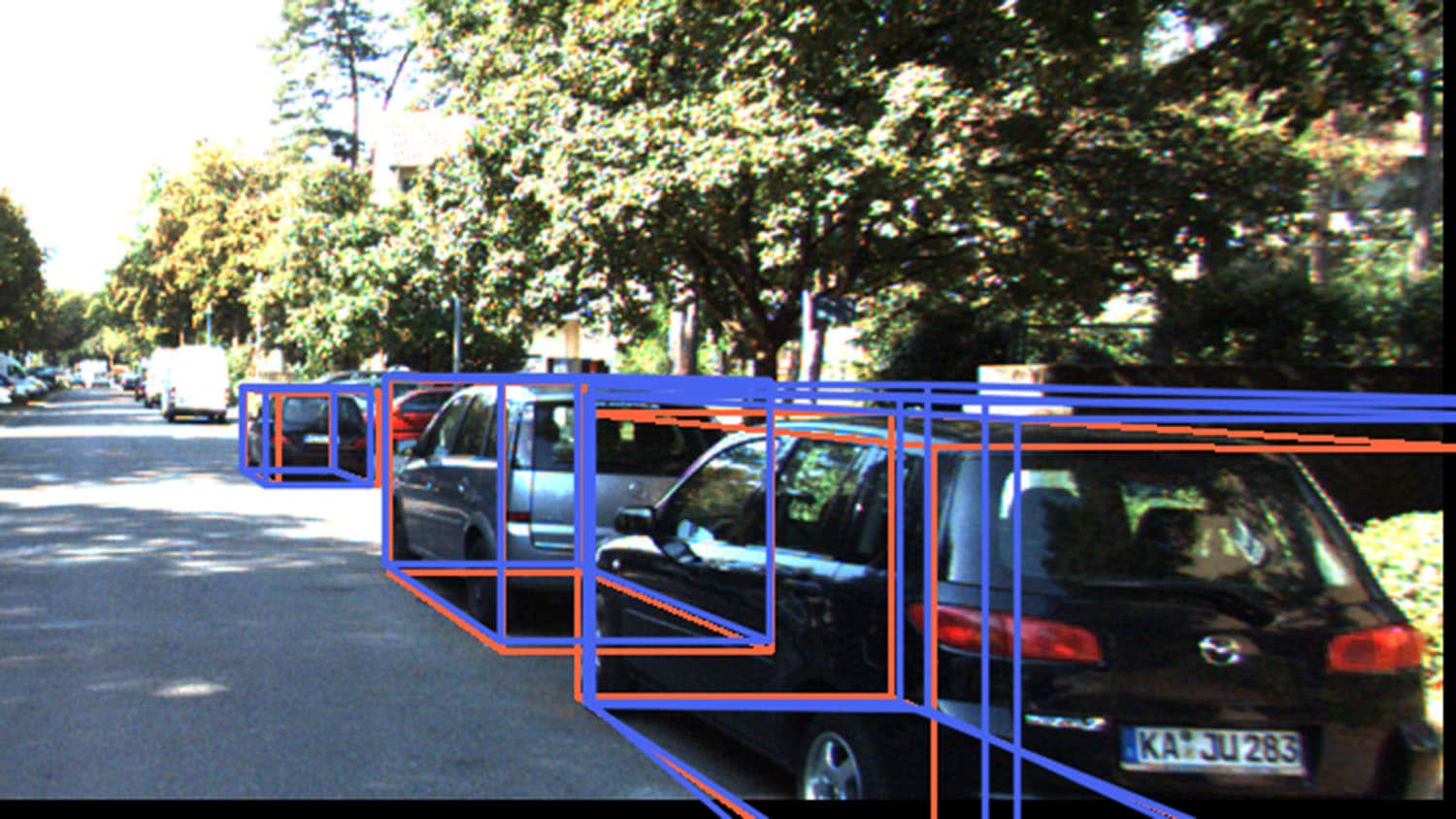

具体来说,MonoCon能够识别2D图像中的3D对象,并将其置于“边界框”中,这将有效地告诉AI相关对象的最外层边缘。

MonoCon建立在大量现有工作的基础上,这些工作旨在帮助人工智能程序从2D图像提取3D数据。这些努力通过“显示”2D图像和在图像中物体周围放置3D边框来训练AI。这些盒子是长方体,有8个点——想想鞋盒上的角。在训练过程中,AI被赋予盒子8个角的每个3D坐标,这样AI就“理解”“包围盒”的高度、宽度和长度,以及每个角与摄像机之间的距离。训练技术使用这个来教人工智能如何估计每个包围盒的尺寸,并指示人工智能预测相机和汽车之间的距离。每次预测之后,训练人员都会“纠正”人工智能,给它正确的答案。随着时间的推移,这让AI能够越来越好地识别对象,将它们放置在一个边界框中,并估计对象的尺寸。

“让我们的工作与众不同的是我们训练人工智能的方式,它建立在之前的训练技术上,”吴说。“与之前的努力一样,我们在训练AI时将对象放置在3D包围盒中。然而,除了要求AI预测摄像机到物体的距离和边界盒的尺寸外,我们还要求AI预测每个盒子的8个点的位置以及它到边界盒中心的二维距离。我们称之为“辅助上下文”,我们发现它可以帮助人工智能更准确地根据2D图像识别和预测3D物体。

提出的方法受到测度理论中一个著名定理的启发,即Cramér-Wold定理。它也可能适用于计算机视觉中的其他结构化输出预测任务。”

研究人员使用一种被广泛使用的基准数据集KITTI测试MonoCon。

“在我们提交这篇论文的时候,MonoCon的表现比其他几十个旨在从2D图像中提取汽车3D数据的人工智能程序中的任何一个都要好,”吴说。MonoCon在识别行人和自行车方面表现良好,但在这些识别任务中不是最好的人工智能程序。

Wu表示:“未来,我们将扩大规模,并利用更大的数据集来评估和调整MonoCon在自动驾驶中的应用。”“我们还想探索它在制造业中的应用,看看我们是否能提高诸如使用机械臂等任务的性能。”

纸”,学习辅助单目上下文帮助单目三维目标检测将在2月22日至3月1日举行的人工智能发展协会(Association for the Advancement of Artificial Intelligence Conference on Artificial Intelligence)上发表。本文的第一作者是北卡州立大学博士生Lu Xienpeng。这篇论文由武汉大学的薛南合著。

本研究得到了美国国家科学基金会(National Science Foundation) 1909644、1822477、2024688和2013451的资助;陆军研究办公室,拨款为W911NF1810295;以及美国卫生与公众服务部社区生活管理局,拨款90IFDV0017-01-00。

希普曼-

编辑:研究摘要如下。

“学习辅助单目上下文帮助单目三维目标检测”

作者:刘先鹏,吴天福,北卡罗莱纳州立大学;武汉大学南雪

提出了:人工智能发展协会人工智能会议,2月22日至3月1日。

文摘:单目三维目标检测的目标是定位输入二维图像中的三维边界框。这是一个非常具有挑战性的问题,并且仍然是开放的,特别是当没有额外的信息(例如,深度、激光雷达和/或多帧)可以用于训练和/或推理时。本文提出了一种简单而有效的单眼三维目标检测公式,无需利用任何额外的信息。提出了一种学习单目上下文的MonoCon方法,作为训练中的辅助任务,帮助单目三维目标的检测。其关键思想是,图像中对象的三维包围盒经过标注后,在训练中可以得到一组丰富的、位置良好的投影二维监督信号,如投影的角点及其相对于二维包围盒中心的偏移向量,在培训中应充分利用这些辅助任务。本文提出的MonoCon是受到测度理论中的Cramér-Wold定理的启发。在实施中,它使用了一个非常简单的端到端设计来证明学习辅助单目上下文的有效性,它由三个组件组成:一个基于深度神经网络(DNN)的特征主干,若干回归头分支用于学习三维包围盒预测中使用的基本参数,以及若干回归头分支用于学习辅助上下文。训练后,为了提高推理效率,丢弃了辅助上下文回归分支。 In experiments, the proposed MonoCon is tested in the KITTI benchmark (car, pedestrian and cyclist). It outperforms all prior arts in the leaderboard on the car category and obtains comparable performance on pedestrian and cyclist in terms of accuracy. Thanks to the simple design, the proposed MonoCon method obtains the fastest inference speed with 38.7 fps in comparisons.

- 类别: